- 1. Génesis de la inteligencia artificial

- 2. Nacimiento de la inteligencia artificial

- 3. ELIZA

- 4. Invierno IA

- 5. La supercomputadora de IBM

- 6. Maquinas que aprenden

- 7. Deep Learning

- 8. IA Generativa

- 9. La IA general es el santo grial

- 10. Enlaces externos

Hablemos de la historia más reciente de la IA.

1. Génesis de la inteligencia artificial

Con el fin de la Segunda Guerra Mundial y las heridas del conflicto todavía cicatrizando, toda una generación de científicos quiso hacer emerger el campo de la computación. El futuro del mundo pasaba por el desarrollo de máquinas capaces de manejar datos como ningún ser humano puede. Sin embargo, por aquel entonces la computación informática se encontraba en sus primeras etapas de vida.

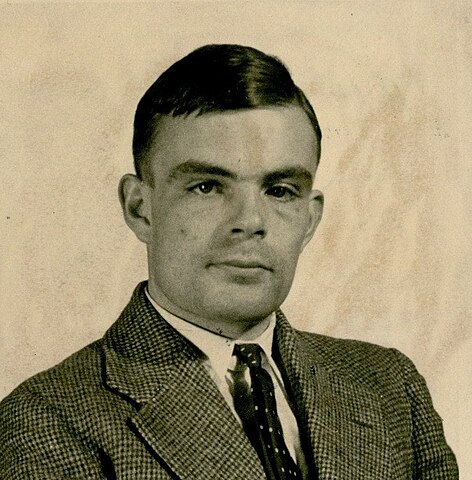

Los fundamentos teóricos heredados del legado de Ada Lovelace (1815-1852, fue la primera en reconocer que la máquina tenía aplicaciones más allá del cálculo puro y en haber publicado lo que se reconoce hoy como el primer algoritmo destinado a ser procesado por una máquina, por lo que se le considera como la primera programadora de ordenadores) y evolucionados por más de 100 años no habían sido acompañados por la tecnología. Seguíamos limitados a simples dispositivos programables para realizar cálculos analógicos, pero algunos sabían que aquella explosión era solo cuestión de tiempo. Y uno de ellos fue el matemático británico Alan Turing, considerado por muchos como uno de los padres de la ciencia computacional. Desde hacía años había fantaseado con un concepto que él llamó máquina universal (UTM), un dispositivo que sería capaz de realizar cualquier tarea que se le asignara y su vida lo había conducido a creer que aquello era posible.

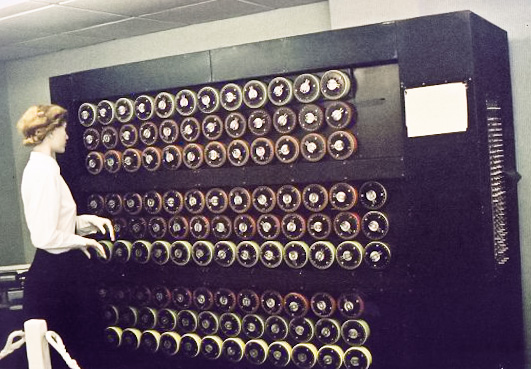

Durante la Segunda Guerra Mundial Alan y su equipo diseñaron una de las primeras máquinas de computación electrónica, un dispositivo bautizado como Bombe que permitió descifrar los códigos de la máquina de cifrado alemana enigma. Su creación permitió romper los códigos enemigos, obteniendo una valiosa información para los aliados. Tras la victoria muchos afirmaron que la creación de Alan redujo la duración de la guerra en dos años.

Bombe no tenía la capacidad de realizar cálculos matemáticos ni de procesar datos, pero su complejidad demostró a su propio padre que estábamos entrando en una nueva era. Alan pensó que si los humanos utilizamos la información disponible y razonamos con ella para resolver problemas y tomar decisiones, una máquina bien programada con una tecnología suficiente, podría hacer exactamente lo mismo.

Warren McCulloch y Walter Pitts (1943) han sido reconocidos como los autores del primer trabajo de IA. Partieron de tres fuentes: conocimientos sobre la fisiología básica y funcionamiento de las neuronas en el cerebro, el análisis formal de la lógica proposicional de Russell y Whitehead y la teoría de la computación de Turing. Propusieron un modelo constituido por neuronas artificiales, en el que cada una de ellas se caracterizaba por estar «activada» o «desactivada»; la «activación» se daba como respuesta a la estimulación producida por una cantidad suficiente de neuronas vecinas. El estado de una neurona se veía como «equivalente, de hecho, a una proposición con unos estímulos adecuados». Mostraron, por ejemplo, que cualquier función de cómputo podría calcularse mediante alguna red de neuronas interconectadas, y que todos los conectores lógicos (and, or, not, etc.) se podrían implementar utilizando estructuras de red sencillas. McCulloch y Pitts también sugirieron que redes adecuadamente definidas podrían aprender. Donald Hebb (1949) propuso y demostró una sencilla regla de actualización para modificar las intensidades de las conexiones entre neuronas. Su regla, ahora llamada de aprendizaje Hebbiano o de Hebb, sigue vigente en la actualidad.

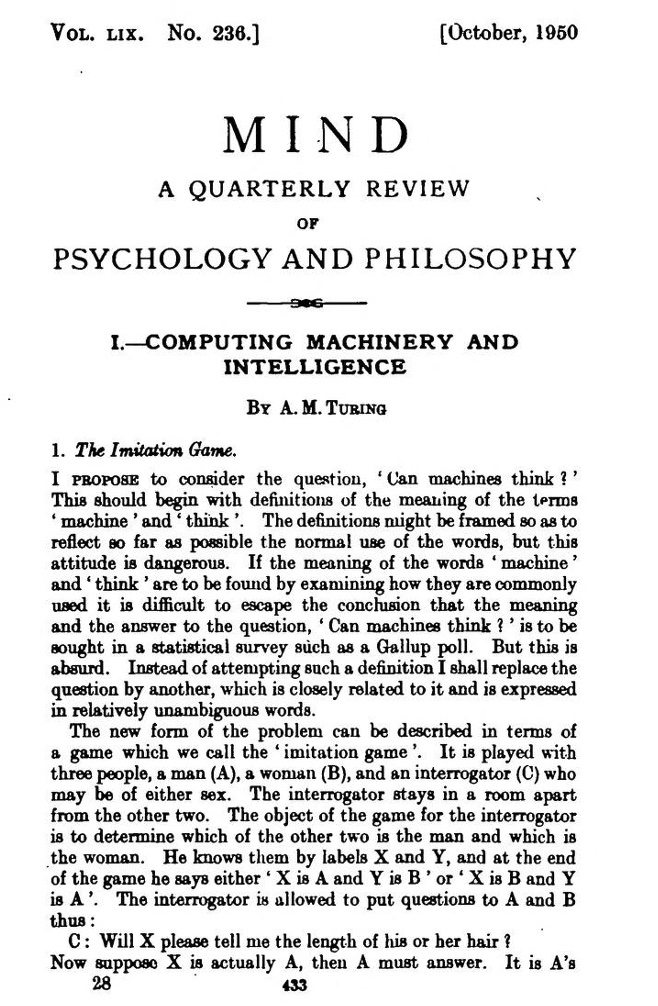

Ese pensamiento fue el marco teórico de un artículo que publicó en 1950, un ensayo donde por primera vez se estaba planteando la existencia de una inteligencia en las máquinas, una inteligencia creada por nosotros programada en los dispositivos.

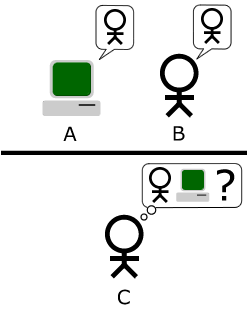

En el artículo Alan planteó un experimento mental, un juego que fue conocido como el Test de Turing. Su planteamiento era muy sencillo, el test involucraba tres participantes, una máquina y dos humanos, uno como entrevistador y otro como entrevistado. El interrogador debe determinar sin ver a ambos partícipes solo a través de preguntas, quién es la máquina y quién es la persona. El ordenador programado para hacer cualquier cosa para forzar una falsa identificación, puede mentir, puede jugar con las respuestas.

Alan planteó que si un número suficiente (después de 5 minutos de conversación, el 70 % del tiempo) de veces el interrogador era incapaz de discernir entre la computadora y el ser humano, podríamos inferir que dicha máquina es inteligente. Así que un ordenador que superara ese test podría ser considerado un ente con inteligencia.

Sin embargo en aquel momento todo esto eran fantasías, sueños que sólo podrían cumplirse en lo que parecía un futuro muy lejano. La ambición de Alan requería de un cambio profundo en los ordenadores. Necesitaba una capacidad que las máquinas todavía no tenían. Las máquinas no podían almacenar instrucciones, sólo ejecutar órdenes. Podíamos decir a los ordenadores qué debían hacer, pero estos no podían recordar lo que habían hecho. Sin esta capacidad, la inteligencia de los ordenadores se antojaba como imposible. Además, la computación iba asociada todavía unos costes inmensos. Sólo las universidades más prestigiosas y las más grandes empresas podían hacer frente a los más de 200 .000 dólares mensuales, que implicaba disponer de un ordenador.

Sólo unos pocos perfiles respetados dentro de ese mundo podían persuadir a los fondos de inversión, convencerlos de que el sueño de la inteligencia en las máquinas era una meta que valía la pena perseguir, poco después Turing fue procesado y condenado por ser homosexual en 1952 no pudo continuar con su carrera.

Dos estudiantes graduados en el Departamento de Matemáticas de Princeton, Marvin Minsky y Dean Edmonds, construyeron el primer computador a partir de una red neuronal en 1951 (llamada Perceptrón). El SNARC, como se llamó, utilizaba 3.000 válvulas de vacío y un mecanismo de piloto automático obtenido de los desechos de un avión bombardero B-24 para simular una red con 40 neuronas. El comité encargado de evaluar el doctorado de Minsky veía con escepticismo el que este tipo de trabajo pudiera considerarse como matemático, pero se dice que von Newmann dijo, «Si no lo es actualmente, algún día lo será».

2. Nacimiento de la inteligencia artificial

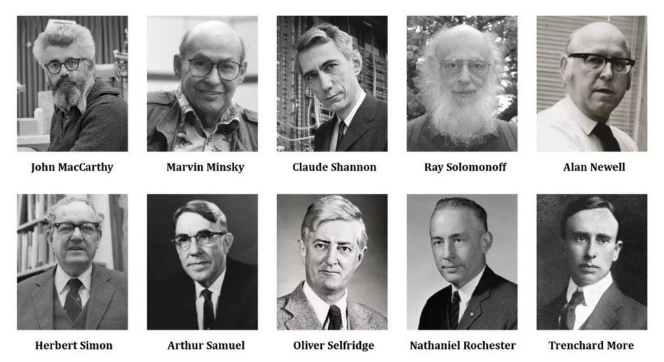

Cuando las ambiciones en el campo empezaban a difuminarse en 1956, el informático estadounidense John McCarthy (inventó el lenguaje de programación Lisp) organizó una conferencia en la Universidad Dartmouth. En ella McCarthy junto a las grandes mentes de la computación del país para un debate acerca de lo que él había bautizado, como inteligencia artificial. El mundo por primera vez estaba oyendo el concepto que marcaría una nueva era.

Durante el verano de 1956, se propuso a 10 académicos reunirse para estudiar la posibilidad de la “inteligencia artificial” financiados por la fundación estadounidense Rockefeller

En la introducción al encuentro se estableció:

Proponemos que durante el verano de 1956 tenga lugar en el Dartmouth College en Hanover, Nuevo Hampshire un estudio que dure 2 meses, para 10 personas. El estudio es para proceder sobre la base de la conjetura de que cada aspecto del aprendizaje o cualquier otra característica de la inteligencia puede, en principio, ser descrito con tanta precisión que puede fabricarse una máquina para simularlo. Se intentará averiguar cómo fabricar máquinas que utilicen el lenguaje, formen abstracciones y conceptos, resuelvan las clases de problemas ahora reservados para los seres humanos, y mejoren por sí mismas. Creemos que puede llevarse a cabo un avance significativo en uno o más de estos problemas si un grupo de científicos cuidadosamente seleccionados trabajan en ello conjuntamente durante un verano. - (McCarthy et al. 1955).

McCarthy estaba convencido de que era posible crear máquinas que pudieran pensar y aprender por sí mismas. Que todo lo que necesitaban, era colaboración y un esfuerzo colectivo. Por desgracia la conferencia no cumplió con sus expectativas. Muchos asistentes creyeron que eran simples habladurías y no alcanzaron ningún consenso a la hora de determinar la metodología para progresar en el campo. Pero aunque no fuera un éxito inmediato, McCarthy había instaurado en las mentes de la comunidad ese concepto de la inteligencia artificial.

Y la conferencia había servido de catalizador para empezar por fin una investigación a gran escala en ese nuevo campo. La inteligencia artificial que había bautizado McCarthy hacía referencia a cualquier dispositivo informático, capaz de percibir su propio entorno y responder con acciones. Unas acciones con el objetivo de maximizar la probabilidad de cumplir con sus objetivos. Queríamos dotar a las máquinas de unas capacidades cognitivas equiparables a las del ser humano. Y en esa misión todo se fundamentaba en aquellos códigos que habían nacido con Ada Lovelace tantos años antes.

Los algoritmos iban a ser la piedra angular de aquella inteligencia artificial. La inteligencia de las máquinas iba a ser la consecuencia de usar algoritmos diseñados para dotarlas de esas capacidades cognitivas.

Un algoritmo es un conjunto de operaciones ordenadas y finitas que permiten a un ordenador realizar cómputos matemáticos y procesar datos. Una secuencia lógica de pasos, unas instrucciones, reglas y órdenes concisas que han sido programadas en la máquina.

3. ELIZA

El ordenador obedece las normas, la sigue y obtiene un resultado. El primer paso en la historia de la inteligencia artificial fue imitar el razonamiento humano. Y en este contexto, tras mucho tiempo de investigación después de muchos errores y uno de los primeros sistemas de inteligencia artificial fue el ELIZA (diseñado en el MIT entre 1964 y 1966), un programa de procesamiento del lenguaje natural diseñado para simular una conversación terapéutica (versión de ELIZA en JavaScript en español).

El algoritmo de ELIZA diseñado por investigadores del MIT funcionaba buscando palabras clave en las frases escritas por el usuario. El considerado primer chatbot de la historia respondía con frases preprogramadas. ELIZA podía imitar suficientemente bien el lenguaje como para mantener una conversación, emular el comportamiento de un terapeuta, pero sólo podía hacer eso, imitar, fingir, que comprendía lo que se le decía, pero sólo estaba respondiendo con frases modelo registradas en su base de datos. Pero con mensajes complejos con preguntas difíciles, la conversación se volvía incoherente. Sin embargo, pese a sus limitaciones, estaba abriendo la puerta a una nueva era. Se había demostrado que podíamos dotar a las máquinas de capacidades equiparables a las nuestras más allá de los números.

Era viable comprender y emular el tan complejo lenguaje humano. Así este y otros éxitos convencieron organizaciones públicas y privadas, que la inversión en la inteligencia artificial era una puesta segura y necesaria.

El optimismo en este joven campo está y hoy las expectativas eran inmensas, porque al mismo tiempo los ordenadores cada vez podían almacenar más información y cada vez eran más rápidos, más accesibles y más baratos.

Los conocimientos técnicos mejoraron los ingenieros eran cada vez más precisos a la hora de saber qué algoritmos aplicar en cada situación, pero superar estos primeros obstáculos no hizo más que mostrarnos la tan alta montaña que teníamos que escalar.

Otra vez nuestros sueños no estuvieron acompañados por la tecnología. Los investigadores habían prometido desarrollar sistemas que pudieran igualar e incluso superar la inteligencia humana en muchas tareas, pero rápidamente descubrieron que necesitaban mucho más, que la capacidad de procesamiento de datos que las máquinas podían darnos.

Habíamos sido demasiado optimistas, los ordenadores todavía eran muy débiles, no tenían el poder de exhibir una inteligencia equiparable a la humana. Parecía que habíamos estado persiguiendo los sueños de Turin y de McCarthy en vano.

4. Invierno IA

A finales de los años 70 el campo de la inteligencia artificial pasó con una crisis de confianza (Invierno IA). La sobrepromoción, las promesas sin cumplir y la falta de avances terminaron por frenar su progreso. Después de una primera etapa de esperanzas, pasaron muchos años sin éxitos. Las empresas que lo habían estado financiando dejaron de verlo como una puesta segura. Los sistemas eran demasiado caros tanto de mantener como de desarrollar. La paciencia de los inversores y de los gobiernos se agotó al tiempo que la sociedad y los propios investigadores veían que aquello no era inteligente. Las máquinas todo lo que hacían eran sumar, restar y multiplicar números muy deprisa, pero no eran inteligentes. Sólo estaban obedeciendo unas instrucciones que una persona había programado a través de esos algoritmos, esa secuencia de órdenes que la máquina sigue a ciegas.

Pero hubo algunos que confiaron y a finales de los años 80 con un poder computacional mucho mayor el interés por la inteligencia artificial estaba renaciendo. Sólo faltaba una cosa, demostrar que las máquinas pueden superar nuestra inteligencia.

En los años 90 la inteligencia artificial volvía a ser una prioridad para las empresas tecnológicas. El crecimiento exponencial de internet con el nacimiento de la World Wide Web había forzado una gran inversión en el campo de la computación, una guerra fría entre las compañías del sector para revolucionar el campo de la IA.

5. La supercomputadora de IBM

Y en esta carrera tecnológica IBM, uno de los mayores gigantes de la tecnología en Estados Unidos, se propuso hacer algo que pusiera su nombre en lo más alto. Cuando Alan Turing puso las semillas de la inteligencia artificial empezó a escribir un programa de ajedrez para un ordenador que todavía no existía, un sistema capaz de entender el juego y competir contra una persona. Desde entonces muchos ingenieros habían trabajado en programas similares al ideado por Turing, cada vez con mayor éxito. En IBM sabían que para hacer honor al padre de la computación y para causar ruido tenían que ir por ese mismo camino, teniendo en sus manos los hardware más potentes de su época y a los mejores ingenieros de software trabajando en sus algoritmos.

Supercomputador Deep Blue

Empezaron el desarrollo de una máquina, bautizada como Deep Blue, un ordenador con un propósito muy simple. convertirse en un experto de ajedrez al que ningún humano pudiera ganar. Una vez construida la supercomputadora Deep Blue se había convertido en uno de los 300 ordenadores más potentes del mundo, una potencia destinada solo a jugar a la ajedrez. Se había alimentado con los datos de más de 700 mil partidas de gran maestros y era capaz de calcular 200 millones de posiciones por segundo. Con sus 256 procesadores podía adelantarse a las jugadas hasta 14 turnos.

No se había creado jamás, una máquina tan potente en una sola función, jugar a la ajedrez. En IBM eran conscientes de que podían volver a poner la inteligencia artificial en el foco y el escenario estaba claro.

Tenían que crear un evento donde Deep Blue se enfrentara uno de los mejores jugadores de todos los tiempos, el vigente campeón del mundo. El gran maestro de ajedrez ruso, Garry Kasparov. Y fue así como el 3 de mayo de 1997 la ciudad de Nueva York fue testigo de uno de los enfrentamientos más mediáticos de la historia del ajedrez.

El ser humano contra una máquina. Kasparov ya se había enfrentado antes a programas informáticos de ajedrez, pero la primitiva tecnología de la IA no tenía absolutamente nada que hacer contra un gran maestro. IBM había prometido que esta vez sería distinto. Y ante la presencia de medios de comunicación de todo el mundo, DeepBlue y Kasparov empezaron su enfrentamiento de seis partidas. La expectación era máxima. Centenares de miles de personas vieron en directo la que muchos llamaban ya la partida del siglo. Seis días después llegaron a la sexta y última partida, con el marcador empatado. Todas habían estado muy igualadas, pero en aquella última DeepBlue y sacó todo su potencial e hizo que ante la incredulidad de todos los asistentes Kasparov abandonara en el 19º movimiento. Uno de los mejores ajedrecistas de la historia había sido derrotado por un ordenador. Era la primera vez que un campeón del mundo perdía contra una IA. La victoria de DeepBlue se convirtió en todo un fenómeno mediático.

La inteligencia artificial volvía a estar en el centro de todas las miradas. Que una máquina hubiera ganado una de las grandes mentes de la gedrez era un símbolo de que la inteligencia artificial estaba atrapando a la nuestra.

Una metáfora del salto que habían dado los ordenadores. Parecía que por fin la inteligencia artificial empezaba a estar a la altura de las promesas hechas en los años cincuenta. Un jaque mate a todos aquellos que dudaron de la inteligencia de las máquinas.

Sin embargo, el momento de fama de DeepBlue no duró demasiado. Muchos afirmaron que no era el gran progreso que habían vendido desde IBM. La máquina había ganado un genio del ajedrez, pero no porque estuviera pensando por sí misma. Lo único que estaba haciendo era seguir unas normas. En el ajedrez tenemos un tablero definido y unas piezas con un rango de movimientos también definido. Todo lo que tenía que hacerse era escribir esas reglas de una forma que el ordenador pudiera entenderlas. A partir de ahí era solo cuestión de fuerza bruta, cálculos para elegir un movimiento. Pero fuera del ajedrez si queremos aplicar la inteligencia en el mundo real, escribir las normas que dominan la complejidad del mundo es virtualmente imposible.

Los ordenadores podían manejar problemas con un conjunto de reglas bien marcadas, pero los retos de la vida real seguían estando el alcante solo de los humanos. La inteligencia artificial solo respondía a comandos de una manera lineal. Estaba ceñida unas normas, a unas leyes codificadas en los algoritmos.

No fue hasta 2015 cuando AlphaGo supero a un jugador profesional de Go. AlphaGo ha sido aclamado como un hito en la investigación de la inteligencia artificial, como Go previamente ha sido considerado como un problema difícil en el aprendizaje de máquinas que se esperaba que este fuera del alcance de la tecnología de la época.

6. Maquinas que aprenden

Con la entrada al nuevo siglo, la IA experimentó un renacimiento. Los avances de principios de los años 2000 incluyeron un gran aumento del poder de procesamiento y sobre todo la disponibilidad de grandes conjuntos de datos (dataset).

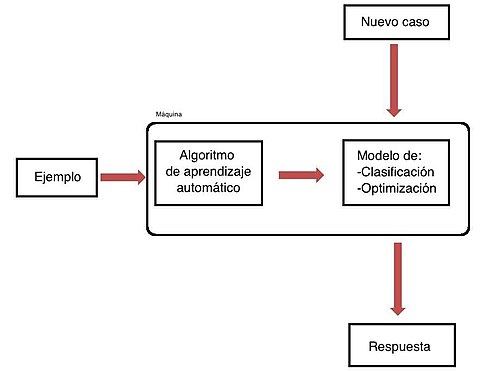

Internet había conectado el mundo y las máquinas tenían acceso a una cantidad de información tan inmensa que se abrió la puerta a una tecnología revolucionaria, una habilidad de computación que fue bautizada como machine learning (ML), la ciencia que buscó conseguir que las máquinas aprendieran como los humanos, acercándonos a una verdadera inteligencia artificial, dotar a las máquinas de la capacidad de aprendizaje.

Las máquinas empezaron a ser capaces de identificar patrones, realizando unas predicciones de forma autónoma. Estábamos cambiando todos los fundamentos. Con los algoritmos convencionales programábamos a las máquinas para que realizaran una acción.

Con el Machine Learning les estábamos programando para que aprendieran a realizar una acción. Con esta revolución la inteligencia artificial se expandió como nunca, integrándose en la sociedad y en el modo como nos relacionamos.

Los algoritmos de Machine Learning hicieron posible las recomendaciones de productos y servicios en Internet, analizando nuestros historiales de compras, comportamientos en la red y preferencias. Los sitios web nos empezaron a presentar publicidad personalizada.

En nuestros correos electrónicos el Machine Learning podía identificar ya patrones en el contenido y en los metadatos, para mostrarlos o esconderlos en la carpeta de spam. Google pudo desarrollar su sistema de búsquedas y de recomendaciones.

Las instituciones financieras usaron la inteligencia artificial para detectar transacciones sospechosas de fraude. Los sistemas de traducción automática llegaron al público general en cualquier idioma, al tiempo que este mismo machine learning empezó a usarse en la medicina, ayudando a los médicos a interpretar imágenes y realizar diagnósticos.

Rápidamente, todas las industrias y campos de la sociedad integraron la inteligencia artificial como una herramienta. Los sueños y las promesas hechas tantas décadas antes. Se habían cumplido. El desarrollo del machine learning hizo que la inteligencia artificial fuera realmente útil por primera vez.

Las máquinas ya no estaban obedeciendo normas, estaban aprendiendo, mejorando automáticamente a partir de millones de datos, sin ser programadas con instrucciones marcadas. El cambio respecto a la programación convencional fue indiscutible.

La inteligencia artificial se había sentado en nuestras vidas y había superado a los humanos en muchas tareas. Si consideramos que la inteligencia es aprender, entonces ya podíamos defender los ordenadores como inteligentes.

7. Deep Learning

Pero en el fondo, todos los expertos sabían que aquello era apenas el principio, que la inteligencia artificial no había hecho nada más que empezar. Si seguíamos anclado a los algoritmos por mucho que diéramos más y más datos a los ordenadores, nos estancaríamos.

Teníamos que ir a por la siguiente gran revolución. Ya teníamos máquinas que aprendían. Era el momento de preguntarnos si podían aprender, si podían liberarse de los algoritmos y emular las conexiones de nuestro cerebro, disponer de una verdadera inteligencia.

Desde muy pequeños los humanos somos capaces de ser humanos, de captar diferencias entre las cosas, por muy sutiles que sean. Basta visualizar un ejemplo de algo para comprender su naturaleza, pero los ordenadores no. Ni siquiera con la revolución del Aprendizaje automático (Machine Learning) habíamos logrado superar esa frontera.

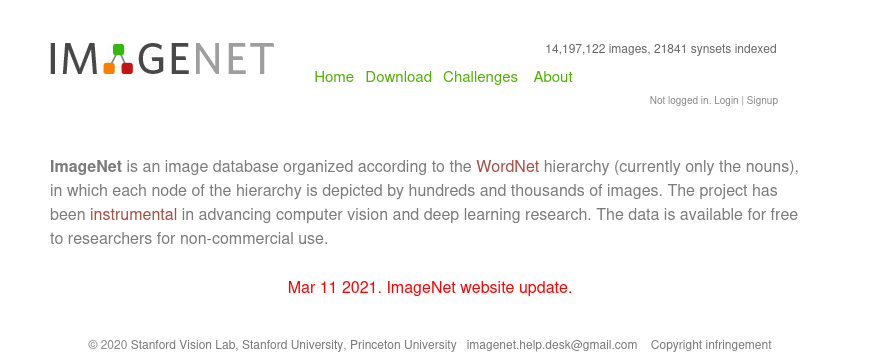

A las máquinas les costaba mucho diferenciar y clasificar imágenes. Era prácticamente imposible por muchos datos e interpretación de patrones que realizara que pudiera hacer algo tan sencillo como distinguir entre la imagen de un perro y la de un gato. Quien diera con el algoritmo que permitiera superar estos retos, estaría abriendo la puerta a una nueva era en el campo de la IA. Y fue así como un equipo de investigadores de la Universidad de Princeton creó una base de datos en forma de colección de imágenes.

El programa llamado ImageNet dispone de más de 14 millones de imágenes divididas en 20.000 categorías. Su objetivo era el de iniciar una competición entre compañías tecnológicas, que los mejores equipos pusieran a prueba sus softwares de Aprendizaje automático para el reconocimiento de imágenes.

Los programas competían entre ellos para ver cómo de buena era la inteligencia artificial a la hora de clasificar objetos y escenas. Pero al principio, ningún obtuvo buenos resultados. Ni siquiera en imágenes tan sencillas como la de una pelota eran capaces de acertar.

Los sistemas más complejos de Machine Learning no respondían. Los algoritmos de aprendizaje expuestos a retos sencillos incluso para un niño pequeño solo acertaban como un 40% de las veces. Parecía que habíamos llegado a ese límite y durante meses ningún programa dio buenos resultados.

Hasta que el 30 de septiembre de 2012, dos años después del inicio del proyecto, un nuevo participante entró en la competición. Un programa desarrollado por tres informáticos de la Universidad de Toronto bajo el nombre de AlexNet.

El software de reconocimiento de imágenes estaba dando unas tasas de acierto de más del 85%. Era una mejora inmensa, una eficacia a la que ningún otro programa se había acercado. El resto de equipos quedaron maravillados.

Porque era evidente que el éxito de AlexNet no era una casualidad. Los científicos detrás del programa habían materializado una nueva forma de inteligencia artificial. Un paso más allá en el Machine Learning, algo que fue bautizado como aprendizaje profundo (deep learning).

Esa nueva idea del Deep Learning estaba imitando el funcionamiento del cerebro humano. Un sistema informático que basa su ejecución en un conjunto de unidades, las neuronas artificiales. Unas unidades de cálculo que emulan el comportamiento de las neuronas naturales, estableciendo conexiones entre varias de su misma red.

Ese conjunto recibía el nombre de red neuronal artificial. Unas redes capaces de calibrarse a sí mismas, no necesitan instrucciones, no necesitan normas. Sólo nos piden que detallemos un objetivo claro porque a partir de él si la alimentamos con suficientes datos, ella misma averiguará los pasos que necesita para llegar a él.

La información pasará por muchas cientos o miles de capas de nodos dentro de la red, atravesando todas las conexiones. Cada capa de neuronas artificiales extrae propiedades más complejas. Y con nuestro feedback diciendo si está acertando o fallando, la propia red cambiará las conexiones entre las neuronas, hasta que haya perfeccionado el recorrido.

Ese es el proceso de entrenamiento, lo que hace que el deep learning exista. Habíamos dado ese último paso. Habíamos liberado a las máquinas de los algoritmos. La era de la inteligencia artificial oficialmente había empezado.

El cerebro humano que es todo lo que somos y todo lo que sentimos está formado por cien mil millones de neuronas y cada una de ellas está realizando 10 mil conexiones con otras, una complejidad que apenas estamos empezando a comprender.

El deep learning nació inspirado por la biología. La información fluye a través de una red neuronal artificial, uno de los mayores saltos en las últimas décadas. Con los algoritmos convencionales las máquinas debían seguir unas normas ordenadas, secuenciadas y concretas, unas instrucciones marcadas por un programador.

Un conjunto de operaciones secuenciales que el ordenador debe seguir para resolver un problema de una forma concreta. Con la red neuronal del paradigma cambia. Ya no le estamos marcando unas normas. Le estamos diciendo a qué objetivo debe llegar y le damos total libertad. No hay instrucciones, solo un objetivo. A partir de ahí, ella puede aprender. Con cientos de algoritmos conectados entre sí en la red, algo más complejo emerge, y repitiendo una y otra vez el proceso pueden calibrarse a sí mismas, mejorando con el tiempo, siendo cada vez más eficientes a la hora de llegar al resultado que le pedimos.

Podrían pasar millones de años que una máquina programada en base en algoritmo seguirá operando de la misma forma, pero con una red neuronal, la cosa es muy distinta. Hay un proceso continuo de cambio, así que la máquina, su manera, está evolucionando.

Con la aparición del deep learning nadie tuvo dudas de que íbamos a presenciar una expansión de la inteligencia artificial sin precedentes. La entrada a una nueva era. Con la errupción del deep learning en el mundo de la programación, los usos de la inteligencia artificial crecieron y mejoraron inmensamente.

Ese verdadero aprendizaje de las máquinas permitió perfeccionar los anteriores sistemas y hacer viables los programas de reconocimiento de imágenes y de voz, con los asistentes virtuales que revolucionaron el mercado, e incluso innovaciones que poco tiempo atrás parecían ciencia ficción, con un ejemplo claro en la conducción autónoma de vehículos.

Los científicos de la computación estaban trabajando en sistemas de IA cada vez más avanzados y complejos, en la exploración de nuevas aplicaciones del deep learning para mejorar nuestras vidas. La inteligencia artificial estaba ya totalmente integrada en el mundo, una simbiosis entre el humano y la máquina.

Sin embargo, por muy impresionante que fuera el progreso, en el fondo, todo lo que estaba haciendo la inteligencia artificial era un navegar a través de los datos, clasificar la información que había sido creada previamente por otros seres humanos.

Por mucho que el poder de computación hubiera permitido el aprendizaje, las máquinas solo jerarquizaban datos, no creaban nada. Era obvio que el siguiente paso en ese camino para aprovechar todo el potencial del deep learning era pasar de clasificar contenidos, a generarlos, darle a la IA unos datos para que aprendiendo de ellos, cree algo único y nuevo, que genere contenido en forma de texto, audio, imagen o vídeo.

8. IA Generativa

Si dábamos ese paso, la inteligencia artificial se convertiría en la creación más importante de la historia de la humanidad. Y fue precisamente con esta voluntad que en el año 2015, algunas de las personalidades más importantes del mundo de la tecnología se juntaron para formar una entidad, una organización para conducir a la inteligencia artificial al siguiente nivel. Acababa de nacer OpenAI. Sam Altman el por entonces presidente de una de las aceleradoras de startups estadounidenses más importantes, junto a otras figuras como la de Elon Musk, creyó que la inteligencia artificial generativa era un reto viable.

Tal vez la mayor ambición desde el nacimiento de esa ciencia, pero podían hacerlo. Dentro de la generación de contenidos, la meta más accesible que tenían era la del texto. Los chatbots habían existido desde hacía décadas.

El propio ELIZA en los años 60 había logrado ya grandes avances. Tanto tiempo después era evidente que podían hacer algo muy potente. Un programa que pudiera mantener conversaciones fluidas con los usuarios, hablando de una forma muy parecida a la de los humanos.

En esencia estarían trabajando con los modelos de lenguaje estadísticos, asignando una probabilidad a una secuencia de palabras para que la IA la mostrara o no. Un sistema de autocompletado muy sofisticado entrenado para crear para generar una respuesta única, no preprogramada. Y para ello deberían diseñar la red neuronal más grande jamás creada. Hasta entonces los modelos de lenguaje. Los ingenieros de OpenAI querían llevarlo al siguiente nivel.

Con su modelo de lenguaje GPT-3 (Generative Pre-Training Transformer) usaron 175.000 millones de parámetros, pero para entrenarlo con tantos datos y tantos parámetros iban a necesitar mucha potencia (ChatGPT y lo que cuesta al planeta la IA conversacional de la que todos hablan). Algo al alcance sólo de los centros de procesamiento de datos de Microsoft, que prestó sus instalaciones para el entrenamiento del programa de OpenAI, con ese poder computación a la su disposición 3 años entre 2016 y 2019. GPT fue entrenado para alimentarse de datos. Le pasaron el Common Crawl, una de las bases de datos más grandes de internet. El Webtex 2 que contiene todos los posts de Reddit con cierta repercusión. Una inmensa biblioteca online de libros y por último, todas y cada una de las páginas de Wikipedia. La creación de OpenAI se había alimentado de prácticamente toda la información disponible en la red.

Estaba lista para ver la luz. Y en noviembre de 2022 su aplicación bautizada como Chat GPT fue lanzada al público. Un chatbot capaz de responder de forma muy humana cualquier pregunta del usuario, con un inmenso conocimiento de cualquier área y con la capacidad de seguir la conversación de forma fluida.

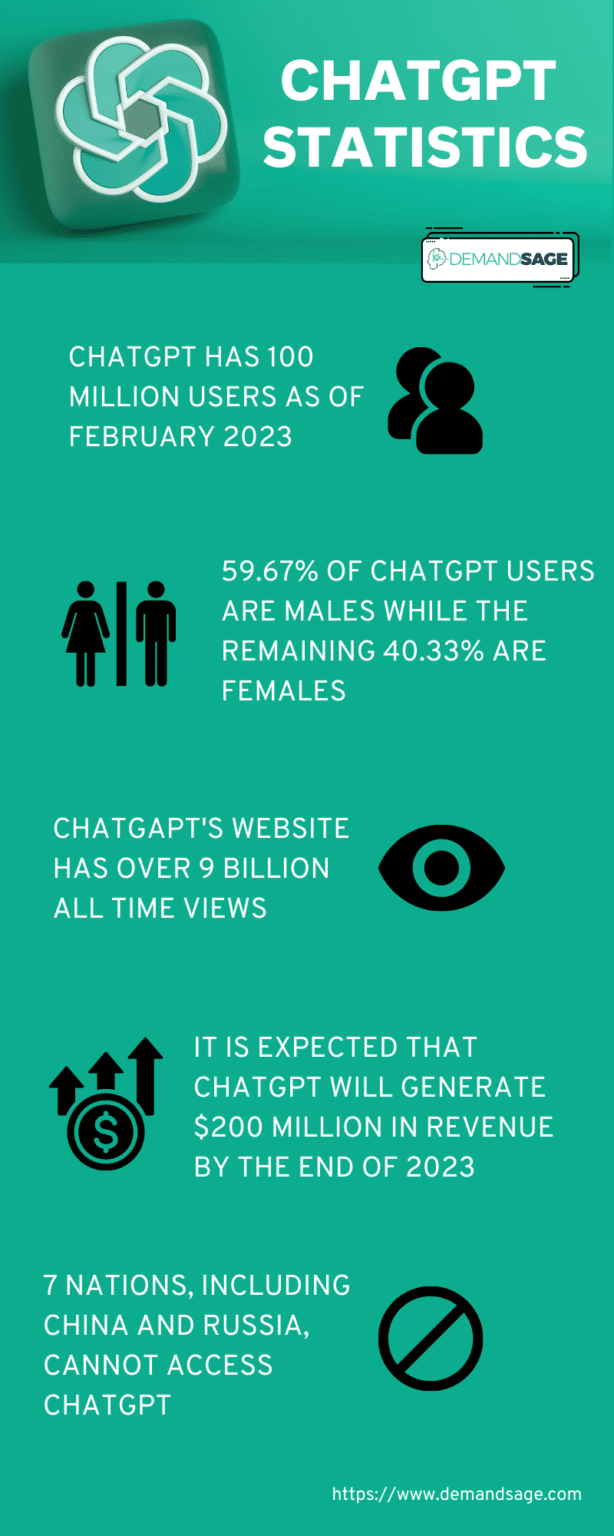

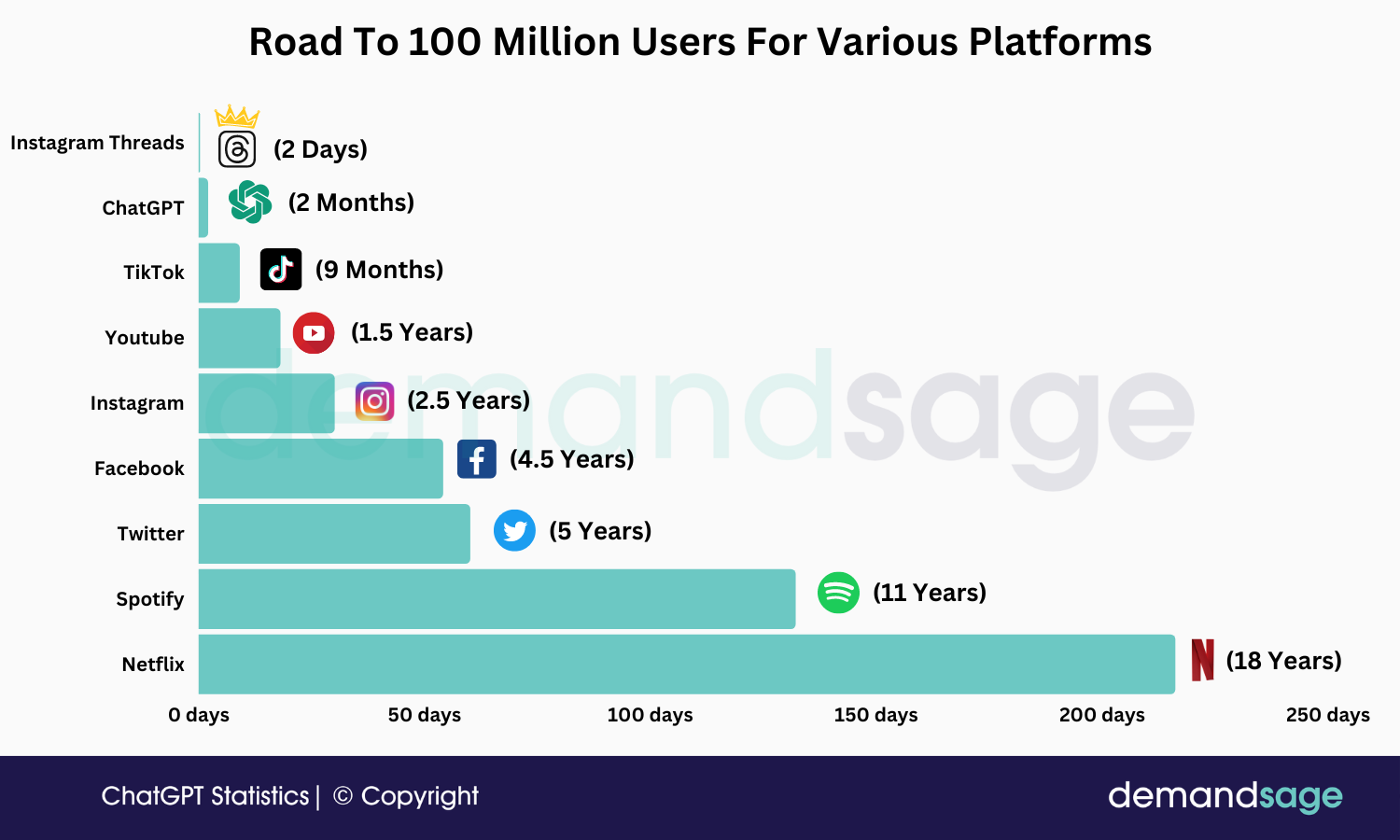

Solo un mes después de estar disponible el programa de OpenAI superó los 100 millones de usuarios mensuales. El crecimiento más rápido de cualquier tecnología en toda la historia. La inteligencia artificial generativa se ha convertido en el tema del momento (32 Detailed ChatGPT Statistics — Users, Revenue and Trends).

ChatGPT es una herramienta que crea textos únicos y otros programas están ya generando imágenes, vídeos e incluso piezas musicales a través de ese deep learning. La inteligencia artificial está creando contenido (otros ejemplos: Midjourney, Dall-e, Stable Diffusion, Bard).

El sector está avanzando a una velocidad que ni los propios programadores podían predecir. Un progreso que ha despertado el debate acerca de dónde estamos y hacia dónde vamos. El amanecer de la inteligencia artificial ha generado una nueva revolución industrial.

Hay quienes tienen miedo desde escenario que ven como todos estos sistemas generativos pueden dar lugar a estafas por su plantación de identidad. Llevarnos a un escenario donde ya no podremos saber qué real y qué no lo es.

Una imagen generada por Midjourney mostrando al Papa

Conducirnos a un futuro donde las compañías que dominan la inteligencia artificial controlen a la sociedad. y, sobre todo, terminar siendo reemplazados por las máquinas, perdiendo nuestros puestos de trabajo ante unos sistemas mejores más rápidos y más baratos que un ser humano.

Por su parte, los defensores afirman que no hay nada que evite el progreso, que la IA ha llegado para quedarse, que no existe una inteligencia artificial mejor que nosotros. Está construida imitando nuestros procesos mentales.

Es una emulación de nosotros. No va a reemplazarnos. Va a mejorar nuestra vida. Van a desaparecer puestos de trabajo, pero otros muchos van a generarse.

Para bien o para mal, la era de la inteligencia artificial está aquí, entre nosotros. Estamos a las puertas de la que tal vez sea la mayor revolución tecnológica de la historia.

Lo que debemos saber ahora es qué vamos a hacer con ella, si será para el beneficio de todos, o será para el beneficio de unos pocos. El gran problema de la IA es que la tecnología está controlada por empresas privadas que no quieren revelar sus secretos, porque quien se alce como líder va a tener una dominancia en el sector durante décadas.

Esa falda de transparencia es lo que ha llevado a la desconfianza general, el miedo a la pérdida de empleos, a los fallos en los chatos, a no saber diferenciar la realidad de la ficción, o a los fraudes invitando voces e incluso a escenarios donde la IA se revela Estos supuestos apocalípticos no son la preocupación de los expertos.

9. La IA general es el santo grial

Las IAs solo pueden aprender aquello con lo que se las entrena, solo tienen un objetivo, solo son buenas en hacer una cosa. Sin embargo, ya estamos trabajando en el siguiente gran paso en la evolución, una inteligencia artificial que sea indistintible en el humana, tan inteligente que pueda resolver problemas para los que no ha sido programada.

La última frontera, la inteligencia artificial general. Ese es el futuro que nos espera, el destino final, antes de alcanzar la singularidad tecnológica. A día de hoy los sistemas de inteligencia artificial han superado a los humanos en muchos dominios, pero no hay ni una sola IA que en todos los dominios, sea como nosotros. Una inteligencia artificial solo puede ser eficaz en un área muy específica. El sistema más complejo, más perfecto de conducción autónoma de vehículos, sería incapaz de diferenciar la imagen de un gato y la de un perro. Por eso estamos trabajando en un siguiente paso en la evolución intelectual de las máquinas.

La inteligencia artificial general es la idea de que podemos dotar a los ordenadores de unas redes neuronales artificiales que les permitan aprender en cualquier situación. Unos sistemas de deep learning que serían indistinguibles del intelecto humano. Las máquinas serían tan inteligentes que al enfrentarse a un problema nuevo, algo para lo que no han sido codificadas, darían con una solución, una idea con más de un objetivo, una idea que aprende igual que nosotros.

No sabemos cuándo llegará ese momento, pero ni siquiera estamos cerca. Las estimaciones indican que la inteligencia artificial general llegará en algún instante en los próximos 50 a 200 años. Será una consecuencia inevitable del progreso y algo que implicará una enorme responsabilidad, porque probablemente esta forma de inteligencia artificial será lo más importante que hayamos hecho en este planeta como especie.

Dar a luz a este nuevo nivel de intelecto. No sabemos qué ocurrirá tras el nacimiento de la idea general, pero muchos especulan acerca de un punto de no retorno. Una evolución en la que ya no solo imitarán a la perfección nuestra forma de pensar, sino que se convertirán en los sistemas más inteligentes, en la faz de la Tierra.

Los humanos habremos dejado de ser la inteligencia superior. Las máquinas serán mejores que nosotros en absolutamente todo. Una súper inteligencia artificial. Los humanos y los chimpancés compartimos el 96% del genoma, y esa diferencia de apenas el 4% nos ha permitido convertirnos en una especie que ha colonizado el espacio.

Nadie sabe qué sería capaz de hacer una superinteligencia tan superior a nosotros. En ese escenario, abriríamos la puerta a la singularidad, un punto en el tiempo en el que la IA ha progresado tanto, que ya es imposible predecir su porvenir, una explosión de conocimiento e información ni siquiera comprensible para los humanos.

Con la singularidad el crecimiento ocurre tan deprisa, que ya es incontrolable. La superinteligencia artificial dotada de todos los datos del mundo, empieza a crear máquinas cada vez más potentes. Y estas a su vez, crean nuevas con más poder.

La IA se mejora a sí misma sin descanso. El destino se ha cumplido. Hemos alcanzado la singularidad tecnológica. Nadie puede saber qué ocurría en el futuro ni si esta singularidad es el destino del progreso.

Lo importante es el presente. que estamos haciendo ahora con la inteligencia artificial y sobre todo, que esperamos obtener de ellas. Parte de la mística de la IA es que es capaz de aprender, pero al final no deja de ser un software.

Hay cero apoyo a la idea de que las máquinas se conviertan en criaturas con sentimientos, con sus propios deseos y metas. Los humanos y las máquinas siempre seremos distintos. Nosotros buscamos nuevas experiencias, aplicamos nuestro conocimiento de acuerdo a los valores.

Las máquinas no, son tecnologías creadas por y para nosotros. No hay ningún ser sintiente solo programas que predicen números, porque una cosa es que dispongan de inteligencia, otra muy distinta es que tengan sabiduría.

Tenemos que conseguir una simbiosis, nos ayudarán a ser más eficientes, harán las cosas que nosotros no queremos hacer, pero hay algo en lo que jamás nos podrán sustituir, en ser humanos, porque somos mucho más que una inteligencia.

Hemos entrado en la era de la inteligencia artificial, un prometedor futuro nos aguarda, pero solo si estamos a la altura de los retos con los que nos vamos a encontrar en ese camino, si estamos a la altura de lo que nos hace humanos.